24 noviembre 2025

18h. Presencial.

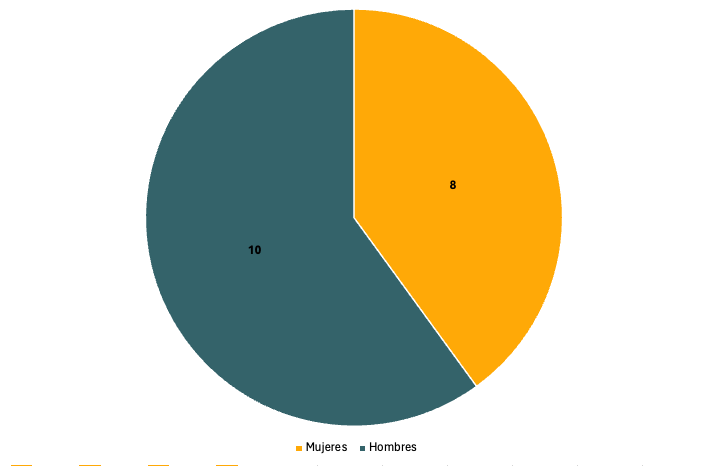

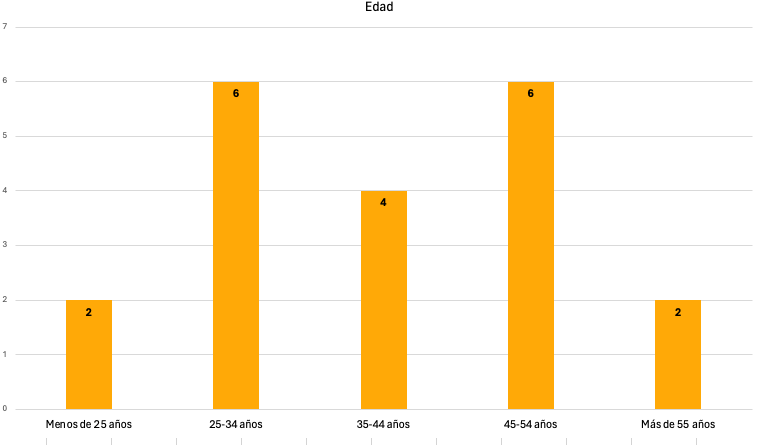

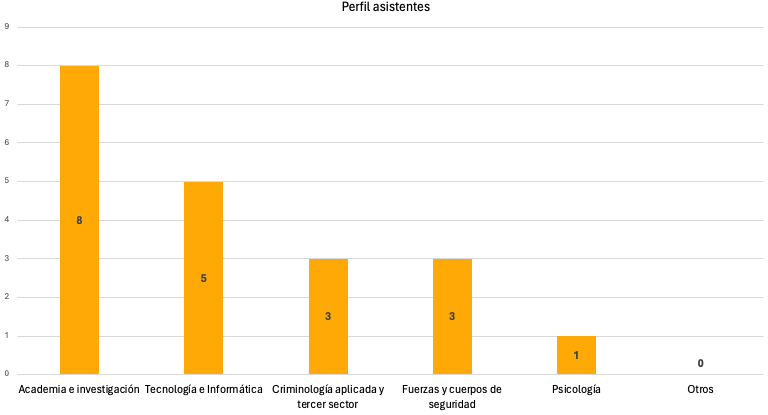

Esta quinta y última CrimiTalk cerró el 2025 con una sesión centrada en el avance de la criminología desde la práctica profesional. El evento estuvo especialmente dirigido a personas que trabajan con delitos y datos reales, y reunió perfiles de la academia, la tecnología, la criminología aplicada, las fuerzas y cuerpos de seguridad y la psicología (ver estadísticas al final de la página).

El formato combinó breves intervenciones iniciales con trabajo en grupos sobre escenarios criminológicos reales, con el objetivo de explorar de manera crítica cómo la inteligencia artificial puede aportar soluciones a problemáticas concretas del ámbito de la seguridad. Posteriormente, se realizó una puesta en común de las ideas surgidas. La sesión contó con la participación de cuatro profesionales con una amplia trayectoria en el uso y la investigación en inteligencia artificial:

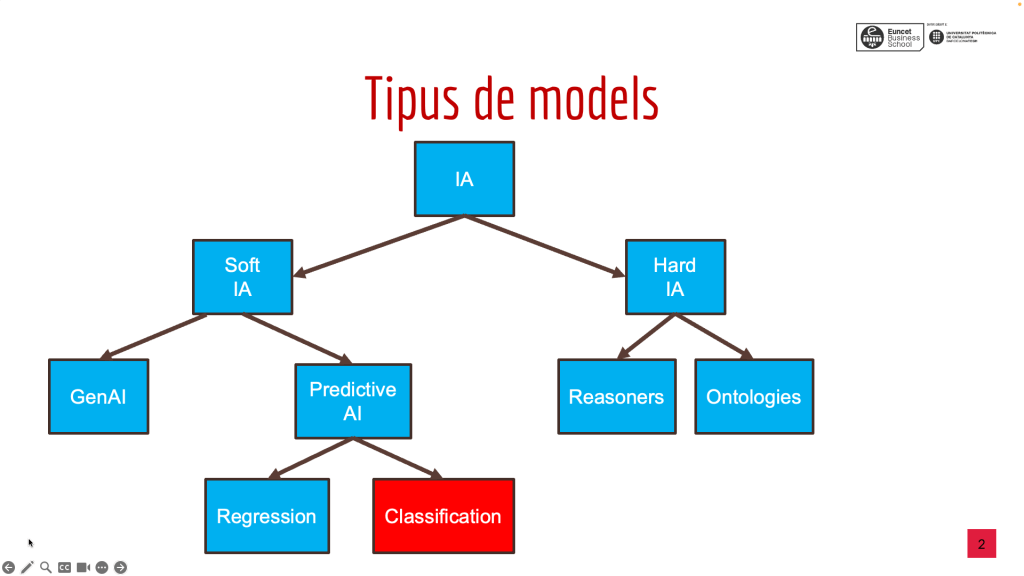

Ignasi Gómez-Sebastià, desarrollador informático y doctor en Inteligencia Artificial por la UPC, abrió el encuentro introduciendo los fundamentos de los modelos predictivos, los distintos tipos de algoritmos y los principales retos en términos de sesgos e interpretabilidad.

Los predictores no trabajan automáticamente; simplemente ayudan al ser humano a tomar decisiones.(Ignasi Gómez-Sebastià)

Oriol Porta, ingeniero en IA y data scientist, presentó la investigación que habían hecho conjuntamente con Ignasi sobre el victim–offender overlap, exponiendo un modelo predictivo orientado a la evaluación del riesgo a partir de variables psicosociales y su potencial como herramienta de cribado preventivo. Rubén Nieto Luna, profesor catedrático de la UOC y miembro de UOC-TECH, compartió su investigación en curso sobre el uso de la tecnología para evaluar experiencias subjetivas como el dolor desde una perspectiva interdisciplinar. Finalmente, Andreas Kaltenbrunner, investigador en el Centre UOC-TECH y responsable del grupo AID4So, cerró la sesión con una reflexión crítica sobre la necesidad de una IA explicable y la gestión de sesgos en el ámbito de la seguridad.

¿Ahora que habéis escuchado algunas de las aplicaciones que puede tener la IA, ¿cómo pensáis que esta se puede aplicar a vuestra realidad como profesionales de la Criminología?

Durante el debate en grupos surgieron muchos temas clave. Uno de los principales fue que los algoritmos no son “neutrales” por sí mismos: los sesgos suelen venir de los datos con los que se entrenan. Por eso, se destacó la importancia de trabajar con datos de calidad y bien equilibrados, ya que, si los datos están sesgados, los resultados del modelo también lo estarán.

Se profundizó en qué entendemos por sesgo, explicándolo como una desviación sistemática en el funcionamiento del modelo. Se pusieron ejemplos concretos, como cuando ciertas características (por ejemplo, el origen migratorio) influyen injustamente en que un sistema clasifique a alguien como fraudulento. También se comentó que algunos sesgos pueden parecer “útiles” desde una lógica de prevención del riesgo, como priorizar falsos positivos. Por ejemplo, esto se traduce en que, en caso de duda, el sistema tienda a señalar un caso como positivo en victimización, con el objetivo de no pasar por alto situaciones de riesgo, aunque ello reduzca la precisión del modelo.

En relación a los posibles sesgos, se introdujo el uso de enfoques contrafactuales para detectar sesgos. Esta técnica consiste en cambiar una sola característica de un caso y observar si la predicción del modelo varía, lo que permite identificar discriminaciones que no siempre son evidentes a primera vista.

Las personas podemos tener sesgos al tomar decisiones y, a veces, esconderlos o no ser conscientes de ellos; en cambio, a una máquina se le pueden hacer preguntas de forma sistemática para ver exactamente dónde aparece ese sesgo.

(Andreas Kaltenbrunner)

Algunos grupos debatieron sobre la posibilidad de generar datos artificiales con modelos como GPT y se preguntaron hasta qué punto estos datos representan a personas reales o si, por el contrario, pueden reforzar patrones y desigualdades ya existentes. Se señaló que entrenar modelos con datos inventados puede amplificar sesgos previos, aunque también se reconoció que este tipo de datos puede ser útil si se utiliza con mucho control.

También se comentaron aplicaciones concretas de la IA en criminología y seguridad: la extracción de información de textos mediante procesamiento del lenguaje natural (NLP) para tener datos de sentencias, reportes policiales o experiencias traumáticas narradas. En los grupos se discutió como estas herramientas podrían facilitar el trabajo de las personas que analizan la historia del individuo a partir de grandes cantidades de información, y cómo podrían ayudar a obtener datos mucho más extensos sobre fenómenos criminales, a partir, por ejemplo, de la información contenida en denuncias.

Finalmente, se concluyó que los sistemas de inteligencia artificial no deberían tomar decisiones por las personas, sino ayudarles a decidir mejor. Especialmente cuando se trata de decisiones con impacto social o penal, la IA debe ser una herramienta de apoyo, no un sustituto del juicio humano.

¿Qué podemos hacer desde la criminología?

- Usar la IA como apoyo a la decisión, no como sustituto. Los modelos predictivos pueden ayudar a identificar riesgos y priorizar casos, pero la decisión final debe recaer siempre en humanos.

- Vigilar los sesgos. Desde la criminología debemos analizar críticamente los datos y los resultados de los modelos para evitar discriminaciones y errores sistemáticos.

- Promover investigación aplicada y ética. Generar evidencia empírica sobre el impacto real de la IA en criminología.

- Fomentar la colaboración entre universidad, expertos y cuerpos de seguridad. Impulsar investigaciones conjuntas que respondan a necesidades reales y tengan una aplicación práctica en el ámbito de la seguridad.

ESTADÍSTICAS

Asistencia: 20 personas